Hostingkosten zijn voor veel organisaties een beetje een sluipend probleem geworden. In het begin valt het allemaal wel mee. Een VPS erbij, wat extra opslag, misschien Redis toevoegen, zwaardere database, wat uitgebreidere back-ups. Allemaal logisch op het moment zelf.

Maar een paar jaar later draait dezelfde website ineens op infrastructuur waarvan bijna niemand meer exact weet waarom alles ooit zo is ingericht. En dat zien wij eerlijk gezegd best vaak, vooral bij Drupal-websites trouwens. Dat zijn namelijk zelden nog simpele websites. Dat zijn vaak geen simpele websites meer maar complete platforms geworden, met koppelingen, imports, exports, formulieren, API’s, zoekmachines, dashboards, tracking, marketingtools. Dan stapelt techniek zich langzaam op. Tot iemand een hostingfactuur ziet en denkt: wacht even… hoe zijn we hier eigenlijk terechtgekomen?

Enter AI analyse.

tl;dr

AI wordt binnen hostingbeheer steeds interessanter omdat het patronen zichtbaar kan maken die in traditionele monitoring vaak verborgen blijven. Vooral bij complexe Drupal-websites ontstaan na verloop van tijd inefficiënties die ongemerkt zorgen voor hogere hostingkosten en zwaardere infrastructuur.

AI vervangt technisch beheer daarbij niet, maar helpt wel om sneller inzicht te krijgen in resourcegebruik, trends en afwijkingen. Daardoor kunnen hostingomgevingen gerichter worden geoptimaliseerd en beter beheersbaar blijven terwijl websites steeds complexer worden.

AI kijkt naar patronen waar mensen niet aan toekomen

Veel hostingbeheer werkt traditioneel vrij reactief. Server traag? Onderzoeken. CPU-load hoog? Kijken wat er draait. Website eruit? Incident oplossen. Niks mis mee trouwens, zo werkt technisch beheer al jaren.

Alleen ontstaat er tegenwoordig zóveel data rondom websites dat het steeds lastiger wordt om alles handmatig goed te blijven interpreteren. En daar wordt AI ineens verrassend praktisch van. Je kan bijvoorbeeld logbestanden combineren met databasebelasting, cronverkeer, cachinggedrag en bezoekersstromen. Vervolgens kan een analysemodel patronen herkennen die je als mens niet direct ziet. Niet omdat AI ineens alles overneemt, maar gewoon omdat het absurd veel data tegelijk kan vergelijken. Veel meer dan je als mens realtime nog een beetje overzichtelijk naast elkaar krijgt.

Denk aan CPU-pieken die steeds op hetzelfde moment terugkomen, geheugenverbruik dat langzaam stijgt sinds een bepaalde update, bots die disproportioneel veel belasting veroorzaken of zoekfunctionaliteit die ongemerkt steeds duurder wordt qua resources. Dat soort dingen dus.

Overcapaciteit komt vaker voor dan je denkt

Wat ondernemers vaak verwachten is dat hostingproblemen ontstaan door te weinig capaciteit. Maar eerlijk gezegd zien wij juist opvallend vaak het tegenovergestelde.

Een website krijgt ergens performanceproblemen, de hosting wordt opgeschaald, de acute pijn verdwijnt grotendeels, en daarna blijft die zwaardere infrastructuur jarenlang bestaan. Terwijl de oorspronkelijke oorzaak misschien allang opgelost is, of nooit echt onderzocht.

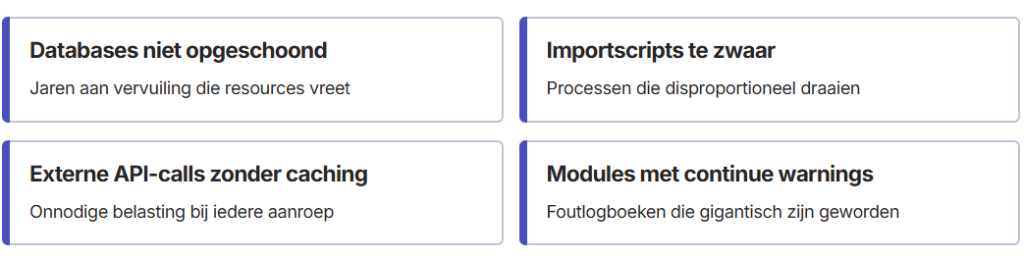

Je komt dan dingen tegen als:

- databases die jaren niet zijn opgeschoond;

- foutlogboeken die gigantisch zijn geworden;

- image styles die continu CPU staan te vreten;

- importscripts die veel te zwaar draaien;

- spamverkeer op formulieren;

- modules die continu warnings produceren;

- externe API-calls zonder caching.

En ja, dan kan je natuurlijk nóg zwaardere hosting nemen. Dat gebeurt in de praktijk ook regelmatig, waarna organisaties soms jarenlang structureel meer capaciteit afnemen dan eigenlijk nodig is, simpelweg omdat niemand nog precies weet waar de oorspronkelijke belasting vandaan kwam. Dat gebeurt ook best vaak. Maar soms los je daarmee vooral symptomen op. AI-analyse helpt juist om structurele patronen zichtbaar te maken. Niet alleen een momentopname, maar trends over langere tijd. En technisch gezien wordt het daar juist interessant van.

De waarde zit in de langere termijn

Eén serverpiek zegt meestal niet zoveel. Interessant wordt het wanneer je over maanden gaat kijken.

Misschien stijgt het geheugengebruik iedere maand een paar procent. Misschien groeit databasebelasting langzaam door vervuiling van loggingtabellen. Misschien ontstaan pieken iedere keer direct na een nieuwsbriefcampagne. Dat soort verbanden zijn voor mensen best lastig zichtbaar, zeker als je meerdere websites beheert.

AI-modellen zijn daar dus juist behoorlijk goed in. We hebben bijvoorbeeld situaties gezien waarbij traditionele monitoring alleen liet zien dát de CPU-belasting opliep, terwijl analyse uiteindelijk zichtbaar maakte dat één specifieke importtaak na iedere externe synchronisatie langzaam geheugen bleef vasthouden. Zoiets kan ongemerkt maanden blijven doorsudderen. Die kunnen duizenden meetpunten naast elkaar leggen en afwijkingen herkennen die anders verborgen blijven. En soms levert dat inzichten op waarvan je achteraf denkt: ja natuurlijk, logisch eigenlijk. Wij hebben bijvoorbeeld situaties gezien waarbij een relatief klein technisch onderdeel uiteindelijk verantwoordelijk bleek voor een groot deel van de serverbelasting. Dingen waarvan je vooraf zou denken: dat zal het toch niet zijn.

Drupal maakt het extra interessant

Bij Drupal komt nog iets extra’s kijken. Veel Drupal-omgevingen groeien jarenlang door. Nieuwe modules, maatwerk, integraties, formulieren, migraties, editors, koppelingen met externe systemen. Alles werkt vaak prima afzonderlijk, maar het totaalplaatje wordt langzaam steeds complexer.

En ja, die complexiteit kost uiteindelijk gewoon resources.

Je kan bijvoorbeeld een koppeling hebben die ieder kwartier complete datasets opnieuw ophaalt terwijl dat eigenlijk nergens voor nodig is. Of search-indexering die veel te vaak draait. Of cronprocessen die elkaar overlappen zonder dat iemand het doorheeft. De website werkt dan nog steeds ‘goed genoeg’. Alleen de infrastructuur moet ondertussen steeds harder werken. Dat zie je uiteindelijk terug in performance, stabiliteit en hostingkosten.

Niet ieder probleem is meteen belangrijk

Wat wij zelf interessant vinden aan AI-analyse, is dat het ook helpt bij prioriteiten stellen. Niet iedere inefficiëntie hoeft namelijk direct opgelost te worden.

Sommige technische afwijkingen zien er eng uit maar veroorzaken nauwelijks belasting. Andere kleine dingen hebben juist enorme impact. Dat onderscheid maken is belangrijk, zeker bij organisaties waar budgetten gewoon realistisch moeten blijven. Je wil niet drie dagen optimaliseren op iets dat uiteindelijk nauwelijks verschil maakt.

AI-gebaseerde analyses kunnen helpen om sneller te zien waar de echte winst zit. Dat scheelt uiteindelijk tijd, geld en soms ook gewoon eindeloos zoeken in logging en monitoring.

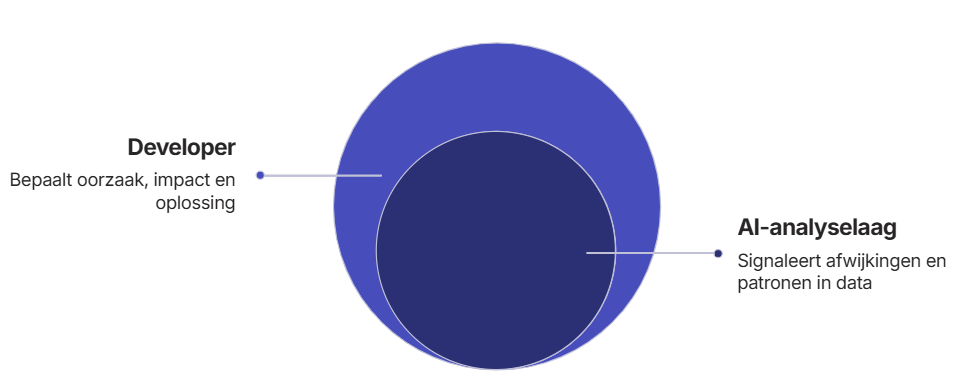

AI vervangt geen technisch beheer

Misschien goed om daar gewoon nuchter in te blijven: AI gaat het beheer van websites niet ineens overnemen. Een analysemodel kan prima signaleren dat een bepaalde query inefficiënt is of dat caching vreemd gedrag vertoont, maar uiteindelijk moet nog steeds iemand begrijpen waar dat vandaan komt en hoe je het oplost zonder elders problemen te veroorzaken.

Dat geldt net zo goed voor infrastructuur, beveiliging en Drupal-configuratie. AI wordt vooral interessant als extra analysetool binnen technisch beheer. Je kan het een beetje zien als een extra analyse-laag die continu technische data doorzoekt op afwijkingen en patronen. Een developer blijft alleen nog steeds nodig om te bepalen wat de oorzaak precies is, welke impact het heeft op de rest van het platform en hoe je het oplost zonder nieuwe problemen te introduceren.

En dat zie je inmiddels breed terug in de IT-sector. Sinds ongeveer 2023 voegen grote cloudplatforms en monitoringtools steeds vaker voorspellende analyses toe aan hun systemen. Dus niet alleen reageren op incidenten, maar juist eerder proberen te signaleren dat iets langzaam de verkeerde kant op beweegt.

Op zich is dat trouwens helemaal niet zo vreemd. Moderne websites produceren tegenwoordig gigantische hoeveelheden technische data, veel meer dan je handmatig nog echt goed kan overzien.

Monitoring vertelt dát er iets gebeurt

Wat in de praktijk vaak goed werkt, is een combinatie van traditionele monitoring en AI-analyse. Monitoring vertelt je meestal dát er iets gebeurt, AI-analyse helpt vaker verklaren waarom.

Je ziet bijvoorbeeld stijgende CPU-load, waarna analyse verband legt met specifieke bots of bepaalde URL-structuren. Vervolgens blijkt een zoekfunctie structureel zwaar belast te worden. Dan krijg je ineens een veel concreter gesprek. Niet meer alleen: “de server is traag”, maar eerder: “dit specifieke gedrag veroorzaakt structureel extra belasting”. En dan kan je veel gerichter optimaliseren.

Hosting wordt steeds dynamischer

Waar hosting vroeger vaak vrij statisch was, één pakket kiezen en daar jarenlang nauwelijks meer naar omkijken, verandert dat beeld inmiddels behoorlijk. Moderne websites ontwikkelen zich continu door. Nieuwe koppelingen worden toegevoegd, content groeit, bezoekersgedrag verschuift, AI-functionaliteit verschijnt binnen bestaande platforms en marketingtools verzamelen steeds grotere hoeveelheden data.

Daardoor verandert ook het karakter van hostingbeheer. Infrastructuur is minder een vaste technische onderlaag geworden en veel meer een bewegend onderdeel van het totale platform. Daardoor merk je ook dat periodieke analyse gewoon belangrijker wordt. Niet alleen wanneer een website aantoonbaar traag wordt of storingen veroorzaakt, maar juist ook in periodes waarin alles ogenschijnlijk stabiel draait.

Veel inefficiënties ontstaan namelijk geleidelijk. Een proces dat ooit acceptabel was, kan maanden later ongemerkt disproportioneel veel resources gebruiken. Dat geldt voor caching, zoekindexering, cronprocessen, importscripts, logging, externe API-calls en eigenlijk vrijwel iedere laag binnen moderne webomgevingen.

Juist daarom wordt inzicht over langere termijn steeds waardevoller. Zeker bij websites die al jaren doorontwikkeld worden en waar ondertussen van alles aan elkaar hangt. Niet alleen om technische problemen op te lossen, maar ook om beter onderbouwde keuzes te maken over infrastructuur, schaalbaarheid en kostenbeheersing.

Uiteindelijk draait het om inzicht

AI-analyse binnen hostingbeheer draait uiteindelijk vooral om beter begrijpen wat er technisch daadwerkelijk gebeurt, zodat infrastructuur beheersbaar en voorspelbaar blijft terwijl websites steeds complexer worden.

Het gaat vooral om beter inzicht krijgen in wat een website werkelijk doet, welke onderdelen disproportioneel veel resources gebruiken, en waar infrastructuur slimmer ingericht kan worden. Soms levert dat directe kostenbesparing op. Soms vooral meer stabiliteit. Vaak allebei. Zeker bij Drupal-websites, waar techniek, content, integraties en maatwerk vaak jarenlang doorgroeien, ontstaat er na verloop van tijd bijna altijd technische ruis die niemand bewust heeft gepland. Dan helpt het enorm als je niet alleen kijkt naar incidenten, maar ook naar patronen.

En daar blijkt AI inmiddels verrassend bruikbaar voor te zijn.